En una aplicación digital, Santiago Barros tiene una idea revolucionaria y conmovedora. Inspirado por la lucha de las Abuelas de la Plaza de Mayo en Argentina, decidió utilizar la Inteligencia Artificial para representar gráficamente cómo lucirían los hijos de los padres desaparecidos durante la siniestra dictadura militar de su país que desapareció a 30,000 personas en 7 años.

En manos del publicista argentino, la Inteligencia Artificial (IA) dejó de ser solo una herramienta tecnológica y se convirtió en un instrumento de esperanza.

En 30 días, Barros sumó más de 6,300 seguidores en la cuenta IAbuelas de Instagram y tiene alrededor de 40 identidades imaginadas que corresponden a bebés robados en 1976, ya trabaja en 1977 y le faltan cinco años para completar toda la dictadura.

Te puede interesar: ChatGPT: La combinación virtuosa de la inteligencia humana con la inteligencia artificial

La IA ha demostrado ser una herramienta poderosa y esperanzadora para reconstruir rostros de la desaparición forzada y la posibilidad de reunir a familias separadas por el horror de la dictadura en Argentina. Sin embargo, junto con la emoción y la esperanza, también surgen preocupaciones sobre su uso en la seguridad pública y su potencial para ser utilizada de manera inapropiada.

“La IA es una herramienta, es como tener martillo y es muy útil. Pero si yo lo utilizo de una manera que lastima, el problema es el ser humano no la herramienta”, dice Karl Ernst Müdespacher, presidente corporativo de Braingine, una de las compañías pioneras mexicanas que desarrolla software de Inteligencia Artificial para uso industrial y en seguridad.

Tecnología de reconocimiento facial: discriminación potencial

En la era digital del siglo XXI, la seguridad pública se enfrenta a desafíos cada vez más complejos como el aumento de la delincuencia, el terrorismo, la desaparición forzada, el acoso escolar, la violencia de género, confictos de los que México no escapa.

En un intento por mejorar la seguridad del país, el ex canciller Marcelo Ebrard presentó el Plan Ángel: Avanzadas Normas de Geolocalización y Seguridad. El proyecto pretende utilizar tecnologías avanzadas, como la inteligencia artificial con reconocimiento facial y morfológico, para detectar criminales por su forma de actuar y caminar.

También puedes leer: Plan Ángel de Ebrard contempla muro cibernético contra el tráfico de armas y aplicación para dar seguridad a mujeres

El reconocimiento morfológico de criminales permitiría establecer patrones de comportamiento y, en teoría, identificar a delincuentes en espacios públicos, lo que en China se ha tratado de hacer con robots y ha despertado inquietudes éticas y de privacidad.

En una investigación de soluciones en IA para identificar rostros y rasgos, sus autores Xiaolin Wi y Xi Zhang aseguran haber encontrado un método exitoso en la identificación de criminales.

En la teoría titulada: “Inferencia automatizada de la Criminalidad usando Imágenes Faciales” sus autores señalan que los criminales tienen ciertos rasgos faciales que pueden ser identificados por un software. De esta manera, la IA podría predecir si una persona es un ladrón en potencia o en casos extremos hasta un asesino.

La teoría realizada en China empleó características faciales como la curvatura de los labios, la distancia entre la esquina interior del ojo y el ángulo nariz-boca. Los resultados afirman que los rasgos del rostro podían inferir eficientemente la criminalidad con una precisión del 89,51% entre 1,856 fotografías analizadas de chinos hombres y mujeres de entre 18 y 55 años.

Sin embargo, los investigadores reconocieron que estaban ingresando en un “terreno pantanoso” debido a las implicaciones éticas y sociales asociadas con la discriminación basada en características físicas.

Para Karl Müdespacher, China no es el mejor ejemplo sobre cómo utilizar la IA para la seguridad pública. “Esto es todavía una teoría pero lo peligroso es que lo ha agarrado gente de tecnología y probablemente también algunos psicólogos, como una verdad absoluta”.

Müdespacher agrega que la IA en manos equivocadas puede ser utilizada por gobiernos autoritarios como el chino “que ha colocado desde hace años, cámaras en la parte de abajo del metro y van viendo a todas las personas que bajan por las escaleras eléctricas y aparece un recuento de qué tan buen o mal ciudadano es aquél para limitarle accesos a créditos, a escuelas y oportunidades”.

Los algoritmos, insiste Karl, “aunque son poderosos” pueden verse influenciados por sesgos humanos lo que lleva a cuestionar la responsabilidad y la ética de utilizar tecnologías “que pueden perpetuar la discriminación y el prejuicio”.

Minority Report: el futuro de la predicción criminal … ¿en la ciencia ficción?

Minority Report es una película que se desarrolla en un futuro distópico en el que se ha desarrollado una tecnología llamada “Precrimen”. Esta innovación utiliza seres humanos con habilidades psíquicas, conocidos como “precogs”, para predecir los crímenes antes de que ocurran.

En la cinta dirigida por Steven Spielberg y lanzada en el año 2002, los presuntos delincuentes son arrestados antes de que cometan un ilícito, lo que lleva a una sociedad aparentemente libre de crímenes.

Quizás quieras leer: Detener criminales, el efectivo uso del espionaje de los gobiernos

El protagonista de la película, interpretado por Tom Cruise, es un oficial de “Precrimen”. Sin embargo, su vida se vuelve un caos cuando es acusado de un asesinato que aparentemente cometerá en el futuro según la predicción de los “precogs”.

A partir de ese momento, el protagonista se embarca en una desesperada búsqueda para demostrar su inocencia y descubrir si el sistema en el que confiaba tiene fallas.

“Yo de verdad espero que nunca nos pase lo de Minority Report”, dice la abogada penalista María de la Paz Orellana Suárez y advierte dos riesgos de utilizar dañinamente la IA para la seguridad: “el uso autoritario y de persecución política contra los opositores”.

La abogada y doctora en derecho penal asegura que la persecución política “ya se hace en México y América Latina” y no sería privativo o excluyente de la IA.

La ética de la vigilancia y el uso de la tecnología para prevenir crímenes se exhibe en una película desde el año 2002 y avizora algo que ya ocurre; un debate sobre la libertad y la privacidad en una sociedad que busca a la IA para luchar contra el crimen.

El papel crucial de la regulación y la transparencia

Ernst Müdespacher desarrolla desde Querétaro un área de la IA que se especializa en el Machine Vision, es decir el procesamiento y análisis de imágenes por computadora. Con esta técnica se analiza en tiempo real el video generado por las cámaras de seguridad generando ventajas a las empresas para prevenir accidentes, detectar fuego, humo, armas, incluso hasta gente desmayada en una planta industrial.

En la compañía Braingine, Müdespacher implementa IA bajo los lineamientos del Reglamento general de protección de datos (RGPD) de la Comisión Europea, las reglas más actualizadas en materia de regulación de datos y la utilización de la Inteligencia Artificial para la seguridad.

En entrevista para Cuestione, el empresario enfatiza que la RGPD hace responsables a las personas que utilizan y que desarrollan la inteligencia artificial en su utilización, se desarrolla en un marco que protege al ciudadano, y se exige instrumentar y explicar los algoritmos para obtener cierta información. Si estos datos son utilizados de manera no adecuada “en Europa las penalizaciones son fuertes”, explica Karl.

“Hubo una empresa en Alemania que fue multada con el 10% de su facturación anual por usar cámaras con sus colaboradores sin estos lineamientos y finalmente la empresa quebró; es una de las consecuencias de no respetar la ley”, cuenta el especialista.

Y es que una de las principales preocupaciones de la IA en América Latina es el uso de tecnologías de reconocimiento facial y morfológico en espacios públicos por la poca protección de la privacidad de los ciudadanos.

También puedes leer: Robots que salvan vidas: una realidad

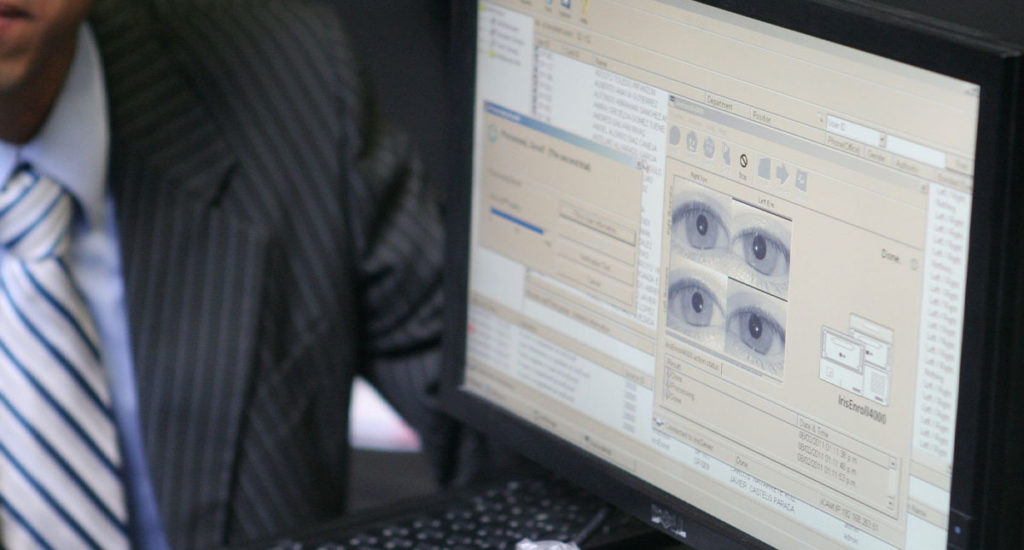

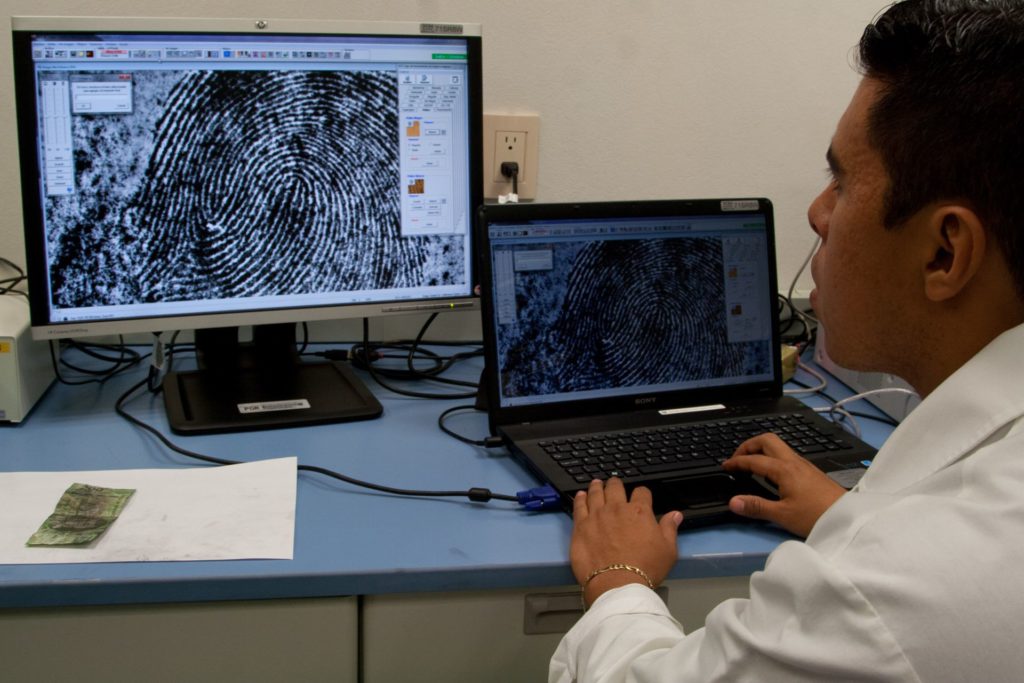

La recopilación y el almacenamiento de datos biométricos pueden ser vistos como una intrusión en la vida privada de las personas y abrir la puerta a posibles abusos de autoridad y por parte de compañías privadas que todavía no comprenden el uso ético de la Inteligencia Artificial.

Sin embargo, tú rostro es público “y no se estaría violando tus datos personales porque quede registrado”, asegura la abogada Paz Orellana.

“Tu rostro está en tu credencial de elector, tu rostro está en todas tus redes sociales donde tú lo expones, no es un dato personal inviolable”, argumenta la penalista. Pero sí es violatorio de los datos personales la retina, la huella dactilar “porque son particularidades que te caracterizan y no necesariamente muchos conocen o saben interpretar”.

Por ejemplo, la Ley Olimpia contra la violencia digital en México, establece un paragüas en casos de mala utilización contra tu imagen y se castiga hasta con 3 años de cárcel a quien sin consentimiento exponga, distribuya, difunda, exhiba, reproduzca, transmita, comercialice, oferte, intercambie y comparta imágenes, audios o videos de contenido sexual íntimo.

La Inteligencia Artificial (IA) ha surgido como una herramienta prometedora para enfrentar estos retos, con su capacidad para analizar grandes cantidades de datos, identificar patrones y predecir comportamientos. Sin embargo, el uso de IA en la seguridad pública también ha despertado inquietudes sobre la posible amenaza de una vigilancia autoritaria.

Karl Ernst Müdespacher y María de la Paz Orellana Suárez coinciden en que en la implementación de tecnologías avanzadas para mejorar la seguridad debe ir acompañada de un enfoque ético, un marco jurídico estricto y un uso responsable de los algoritmos.

El diálogo entre los responsables de la formulación de políticas, expertos en tecnología y derechos humanos, así como la sociedad en general es crucial para abordar los desafíos y garantizar que las medidas adoptadas en lugar de ser autoritarias e invasivas, sean prometedoras y beneficiosas para todas y todos.

Sin regulación o sin aplicación de la ley, la IA podría caer en manos incorrectas y eso es “como agarrar el carro e ir a atropellar gente porque nada va a pasar”, ironiza Müdespacher mientras se muestra convencido que existen brechas que no deben pasarse por alto, como lo es el uso ético de ese “Gran Hermano”.

La globalización de la IA en la seguridad: un panorama global

La Inteligencia Artificial (IA) ha irrumpido en el ámbito de la seguridad en todo el mundo, convirtiéndose en una herramienta esencial para gobiernos y fuerzas policiales en su lucha contra el crimen y la protección de la ciudadanía.

A continuación, explicaremos cómo varios países han implementado la IA en sus estrategias de seguridad y cómo usan la tecnología para hacerle frente a los desafíos del siglo XXI.

Estados Unidos

EU ha sido uno de los líderes en la adopción de la IA en seguridad pública. Recientemente el Secretario de Seguridad Nacional anunció que utilizará la IA para combatir el tráfico ilegal de fentanilo y se establecerá un grupo de trabajo para explorar cómo se puede usar esta tecnología para aumentar la seguridad en el país. También EU está utilizando algoritmos para predecir y prevenir delitos en áreas de alto riesgo y el reconocimiento facial se ha utilizado ampliamente en aeropuertos y otras instalaciones para mejorar la seguridad y detectar posibles amenazas.

China

China ha invertido fuertemente en tecnologías de IA para la seguridad. El país ha implementado un sistema de vigilancia masiva, conocido como “Sistema de Crédito Social”, que utiliza reconocimiento facial y análisis de datos para monitorear el comportamiento ciudadano y calificar su nivel de confiabilidad social. Además, la IA se utiliza en la identificación de criminales y en la vigilancia de grandes eventos públicos.

Reino Unido

En el Reino Unido es el país líder de Europa en inteligencia artificial. La IA se ha aplicado en la detección de amenazas y la prevención del terrorismo. Los sistemas de análisis de redes sociales y procesamiento del lenguaje natural se utilizan para monitorear actividades sospechosas y detectar posibles atentados. Además, la IA ha sido clave en la lucha contra el cibercrimen y la protección de datos sensibles.

Israel

Israel ha sido pionero en la aplicación de la IA en el campo de la seguridad. El país ha desarrollado drones y sistemas autónomos para tareas de vigilancia y patrullaje. Además, la IA se ha utilizado para mejorar la capacidad de los servicios de inteligencia en la identificación de amenazas y la recopilación de información.

Emiratos Árabes Unidos

Los Emiratos Árabes Unidos han adoptado la IA en diversas áreas de seguridad, incluyendo el control fronterizo y el reconocimiento facial en espacios públicos. La tecnología de IA también se ha implementado en la prevención del tráfico de drogas y la identificación de delincuentes que están siendo buscados.

Brasil

Brasil ha incorporado la IA en sus estrategias de seguridad pública para abordar el crimen organizado y reducir la violencia. El análisis predictivo y la vigilancia inteligente se han implementado en algunas ciudades para mejorar la eficiencia de las fuerzas policiales y se está legislando para regular el uso de la IA.